Argomenti trattati

Negli ultimi anni il dibattito sull’innovazione digitale ha posto al centro gli agenti AI, ossia software progettati per prendere decisioni e agire in autonomia su compiti complessi. Per agente AI si intende un sistema in grado di valutare l’ambiente, scegliere azioni e apprendere dai risultati. La crescente attenzione deriva dall’impatto potenziale su processi aziendali e modelli di business.

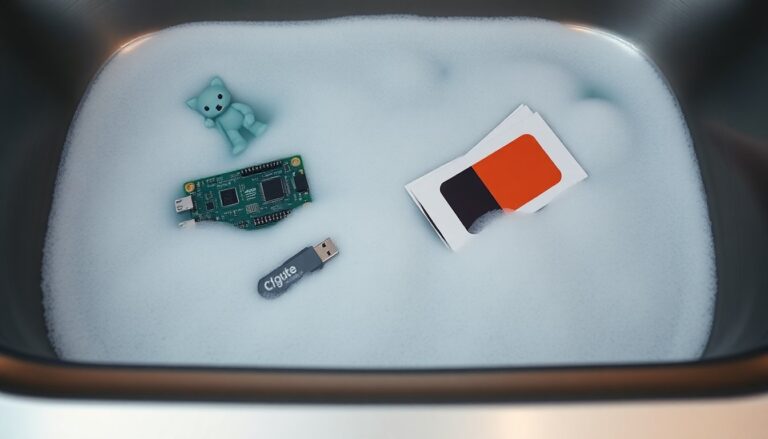

Parallelamente è emerso un fenomeno di marketing definito agent washing: la pratica di promuovere come agenti intelligenti strumenti che offrono in realtà automazione avanzata o chatbot potenziati. Distinguere le due categorie è fondamentale per evitare investimenti errati e per progettare iniziative di trasformazione digitale orientate a risultati misurabili.

Cosa sono davvero gli agenti AI e perché contano

Dopo aver distinto le categorie, conviene chiarire la definizione operativa. Un agente AI è un’entità software che percepisce l’ambiente, definisce obiettivi, prende decisioni autonome e interagisce con sistemi esterni per eseguire processi complessi. Questa capacità decisionale e di azione autonoma li differenzia dagli assistenti conversazionali e dagli strumenti di automazione basati su script predeterminati. In ambito aziendale, i veri agenti possono orchestrare flussi come onboarding, reconciliation delle fatture o il monitoraggio antifrode, con un impatto diretto su tempi di lavorazione, tolleranza agli errori e costi operativi. L’implementazione richiede inoltre controlli di governance, metriche di performance e integrazione sicura con i sistemi legacy, elementi necessari per tradurre l’autonomia tecnica in risultati di business misurabili.

Il valore strategico per le PMI

Per le piccole e medie imprese l’adozione di agenti software autonomi può tradursi in vantaggi concreti: aumento della efficienza, migliore allocazione delle risorse e rapido rilevamento di anomalie operative. Tuttavia, ottenere questi risultati richiede un’adeguata integrazione con i sistemi esistenti, competenze tecniche specifiche e una chiara definizione dei casi d’uso.

In assenza di tali condizioni l’autonomia resta prevalentemente teorica e il ritorno economico fatica a materializzarsi. Per convertire capacità tecniche in benefici misurabili, le imprese devono investire in formazione, processi di governance e strumenti di monitoraggio delle performance, oltre a piani di integrazione incrementali con i legacy system.

Che cos’è l’agent washing e quali rischi comporta

Dopo l’implementazione di piani di governance e monitoraggio, emerge un rischio operativo e reputazionale per le imprese. L’agent washing si verifica quando un prodotto viene presentato come agente autonomo ma non possiede reale capacità decisionali né autonomia operativa.

Questo fenomeno genera due conseguenze principali. Primo, crea aspettative irrealistiche nei decisori aziendali che possono tradursi in investimenti sovrastimati e risultati inferiori alle previsioni. Secondo, erode la fiducia degli stakeholder nella tecnologia, con possibili ripercussioni su finanziamenti e adozione di soluzioni future.

In termini pratici, le aziende rischiano ritardi nei progetti e costi aggiuntivi per integrare controlli manuali e revisione umana. Inoltre, i fornitori che promuovono funzionalità non reali espongono sé stessi a contestazioni contrattuali e danni reputazionali.

Per mitigare i rischi sono necessari criteri di valutazione chiari e metriche di performance che distinguano l’autonomia effettiva dall’insieme di funzionalità assistite. Un controllo indipendente delle capacità dichiarate e un piano di integrazione graduale con i sistemi esistenti riducono la probabilità di insuccesso e preservano la fiducia degli investitori.

Impatto sui progetti e sul mercato

Se la governance e l’integrazione non sono adeguate, gli strumenti semplici venduti come innovativi possono compromettere i programmi aziendali. I costi imprevisti e i benefici marginali aumentano il rischio di cancellazione dei progetti. Ne deriva una contrazione degli investimenti e difficoltà operative per le startup che sviluppano soluzioni autentiche. La conseguente confusione di mercato ostacola gli acquirenti nella distinzione tra innovazione reale e rebranding commerciale, riducendo la capacità di allocare risorse in modo efficiente.

Come distinguere un vero agente AI da un prodotto rebrandizzato

Per gli acquirenti aziendali la valutazione si basa su criteri operativi e misurabili. Il primo elemento da verificare è il livello di autonomia: il sistema può definire e perseguire obiettivi senza interventi continui o richiede istruzioni passo dopo passo? Questo aspetto determina l’effettiva capacità dell’agente di ridurre il carico decisionale interno.

In secondo luogo va esaminata l’integrazione con sistemi esterni. Occorre verificare se la soluzione comunica nativamente con CRM, ERP, piattaforme di dati e strumenti di automazione. La possibilità di orchestrare processi end-to-end è indicativa di una piattaforma progettata per operare in contesti aziendali complessi.

È inoltre fondamentale valutare la gestione dei workflow e la resilienza operativa. Un agente autentico coordina attività, gestisce eccezioni e registra audit trail senza dipendere da interventi manuali continui. Queste funzionalità riducono i rischi di errore e facilitano la compliance.

Infine le imprese devono richiedere misure di performance su casi d’uso reali. Test pilota con indicatori come tempo di completamento, tasso di automazione e impatto sui costi consentono di separare le promesse commerciali dal valore concreto. Sviluppi futuri della tecnologia e rapporti di terze parti forniranno ulteriori elementi di confronto.

Linee guida operative

In continuità con le analisi precedenti, le aziende dovrebbero adottare misure concrete per valutare e scalare progetti di intelligenza artificiale. Per prima cosa è necessario definire KPI collegati ai processi operativi specifici. Le metriche devono misurare risultati tangibili e tempi di ritorno sull’investimento.

Si raccomanda inoltre di avviare proof of concept limitati ma rappresentativi del carico di lavoro. Preferire architetture ibride che coniughino modelli generativi con componenti deterministici migliora robustezza e riproducibilità. Infine, istituire regole di governance per monitorare le decisioni algoritmiche e l’accesso ai dati consente di contenere i rischi e favorire la scalabilità. Tali pratiche aumentano la probabilità di trasformare sperimentazioni efficaci in soluzioni operative.

Progettare l’adozione senza cadere nelle trappole dell’hype

Seguendo le pratiche indicate, le sperimentazioni efficaci possono essere trasformate in soluzioni operative con maggiore rapidità. È consigliabile adottare un approccio graduale che privilegi l’integrazione di funzionalità agentiche come fase evolutiva e non come rivoluzione immediata.

Il primo passo consiste nel selezionare processi operativi chiari e a elevato impatto, così da dimostrare valore in tempi brevi e consolidare la fiducia degli stakeholder. Contestualmente, è necessario implementare controlli di governance su dati e decisioni per mitigare rischi legali e reputazionali e definire responsabilità precise.

Le organizzazioni devono inoltre sviluppare competenze per riconoscere e contrastare l’agent washing, intendendo con questa espressione la presentazione commerciale di capacità non effettive. Separare marketing e capacità reali consente di concentrare investimenti su soluzioni che offrono valore concreto e scalabilità.

Infine, una road map operativa basata su metriche di performance e indicatori di rischio facilita il passaggio da progetti pilota a implementazioni su scala, aumentando la probabilità di risultati sostenibili e misurabili.